Una Revolución en la Interacción Humano-Máquina

El Procesamiento del Lenguaje Natural (PLN) en la Inteligencia Artificial (IA) es una herramienta revolucionaria que está cambiando la forma en que interactuamos con la tecnología en 2024.

Este artículo busca desentraña el PLN, explicando sus mecanismos y mostrando cómo influye en nuestra vida diaria.

Descifrando el PLN: La Inteligencia Artificial que Entiende el Lenguaje Humano

El PLN es una innovación clave en la IA, permitiendo a las máquinas comprender y generar lenguaje humano.

Es como tener un asistente que no solo entiende lo que decimos, sino que también capta el significado detrás de nuestras palabras.

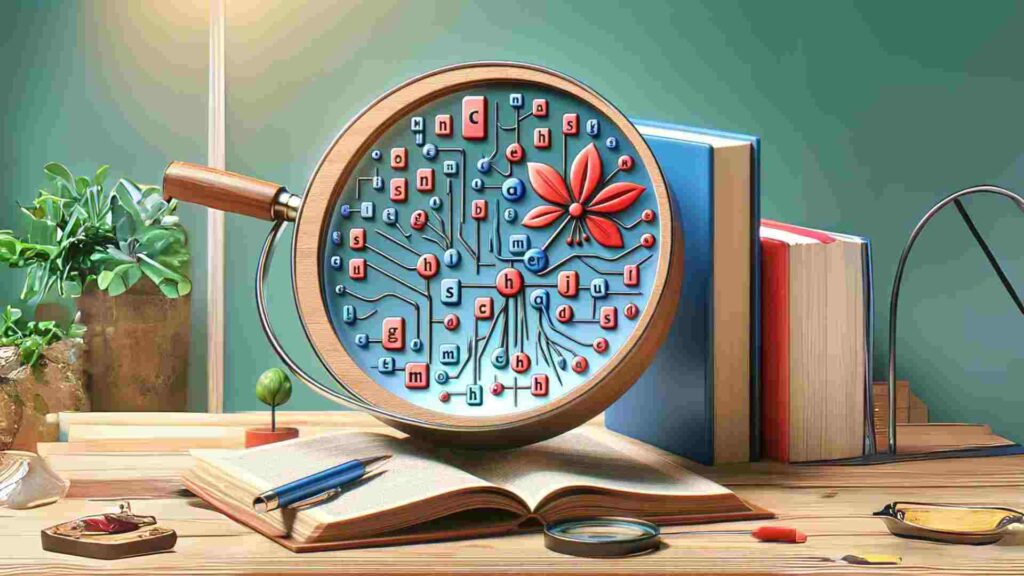

Explorando las Capacidades del PLN: De la Tokenización al Aprendizaje Automático

El PLN despliega una serie de funciones avanzadas:

Tokenización: Esta etapa descompone el texto en partes más pequeñas (tokens), como palabras o frases.

Por ejemplo, en la oración «Los gatos duermen», los tokens serían «Los», «gatos», «duermen». Esto es fundamental para que las máquinas entiendan la estructura básica del lenguaje.

Análisis Morfológico: Examina cómo se forman las palabras. Por ejemplo, al analizar «corriendo», el PLN identifica que es el gerundio de «correr», lo que ayuda a comprender la acción en el contexto.

Análisis Sintáctico: Aquí, el PLN evalúa cómo se organizan las palabras en una oración. En «El niño come manzana», el PLN identifica «El niño» como sujeto, «come» como verbo y «manzana» como objeto.

Análisis Semántico: En esta fase, el PLN busca entender el significado de las palabras y su relación. Por ejemplo, distingue que «banco» puede referirse a una institución financiera o a un asiento, según el contexto.

Desambiguación: Resuelve ambigüedades en el lenguaje. Si decimos «Voy al banco», el PLN usa el contexto para determinar si nos referimos a una entidad financiera o a un mueble para sentarse.

Aprendizaje Automático: Aquí, el PLN utiliza algoritmos para aprender de los datos. Un ejemplo es cómo los sistemas de recomendación, como los de Netflix, analizan nuestros gustos previos para sugerir nuevas películas.

El PLN y su Rol en la Evolución de la IA

El futuro del PLN en la IA es brillante. A medida que estas tecnologías continúan avanzando, las posibilidades de cómo el PLN puede mejorar nuestra vida cotidiana son infinitas, llevándonos hacia un mundo donde la comunicación entre humanos y máquinas es más fluida y natural que nunca.